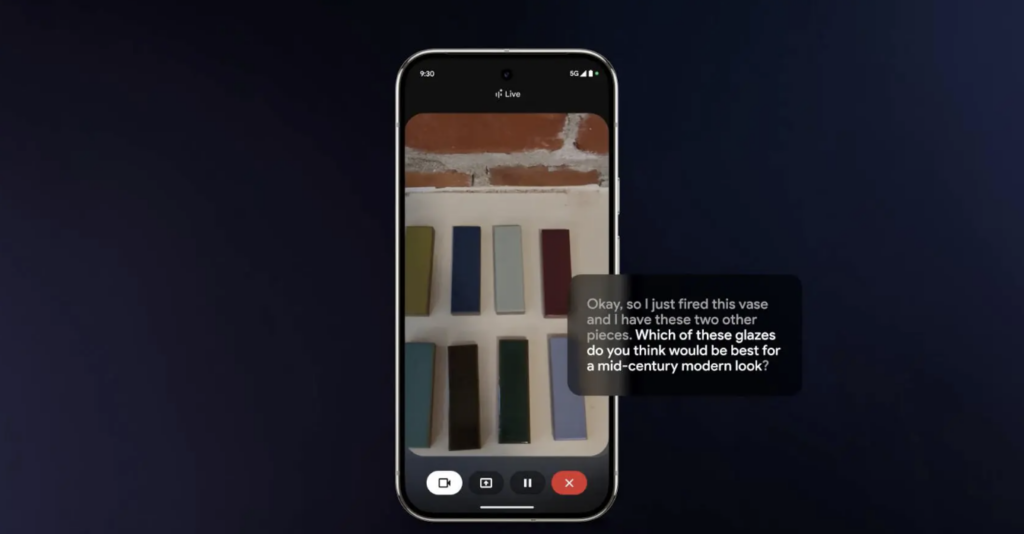

San Luis Potosí, sábado 29 de marzo de 2025.- Google ha dado un gran paso en la evolución de la inteligencia artificial con el lanzamiento de Project Astra para Gemini Live, un avance que permite a la IA comprender mejor el contexto de una conversación al integrar vídeo y capturar lo que está sucediendo en el entorno del usuario. Esta nueva función permite que Gemini Live use la cámara y la pantalla del dispositivo para obtener información adicional, proporcionando una interacción más precisa y personalizada. A través de esta tecnología, el asistente puede “ver” lo que el usuario está grabando o viendo en su pantalla, lo que abre un abanico de posibilidades, como recomendar productos basados en lo que el usuario está visualizando.

Este avance en la IA se presentó inicialmente en el MWC de Barcelona y está comenzando a ser implementado gradualmente para los usuarios. Sin embargo, aún no está disponible en todos los mercados, aunque Google ha confirmado que el lanzamiento será progresivo. Además, este avance estará disponible solo para los suscriptores de Gemini Advanced, un servicio de pago que forma parte del paquete Google One AI Premium, el cual ofrece integración de Gemini con otras aplicaciones de Google y almacenamiento adicional en la nube.

Lo más interesante de esta nueva funcionalidad es su potencial para revolucionar la forma en que interactuamos con nuestros dispositivos. Además de las aplicaciones en móviles, Gemini Live con Project Astra tiene grandes implicaciones para el futuro de los dispositivos inteligentes, como las gafas de realidad aumentada de Google y Samsung, que se están desarrollando para integrar esta IA de manera aún más profunda en la vida cotidiana. Sin duda, esta es una de las actualizaciones más esperadas en el mundo de la inteligencia artificial.